TERCEIRA QUANTIZAÇÃO E RELATIVIDADE SDCTIE GRACELI EM

Densidade dos estados.

Em física estatística e física da matéria condensada, densidade de estados (DOS, do inglês density of states) é a propriedade que quantifica quão proximamente "empacotado" em níveis de energia está um sistema mecânico quântico. Um DOS alto em um nível específico de energia significa que há muitos estados disponíveis para ocupação. Um DOS nulo, zero, significa que nenhum estado pode ser ocupado em um nível de energia.

Explanação

Ondas, partículas comportando-se como ondas, podem somente existir dentro de sistemas mecânico quânticos (MQ) se propriedades do sistema seguem a ondulação existente. Em alguns sistemas, o espaçamento interatômico e a carga atômica do material segue somente elétrons de certos comprimento de onda existentes. Em outros sistemas. a estrutura cristalina do material leva ondas a se propagar em somente uma direção, enquanto suprime a propagação de ondas em outra direção. Ondas em um sistema MQ tem comprimentos de onda específicos e podem propagar-se em direções específicas, e cada onda ocupa um diferente modo,ou estado. Devido a muitos destes estados terem o mesmos comprimentos de onda, entretanto dividirem a mesma energia, podem existir muitos estados disponíveis em certos níveis de energia, enquanto nenhum estado é disponível em outros níveis de energia.

Por exemplo, a densidade de estados para elétrons em um semicondutor é mostrada em vermelho na Fig. 2. Para elétrons na fronteira da faixa de condução, muito poucos estados estão disponíveis para o elétron ocupar. A medida que o elétron aumenta em energia, a densidade de estados do elétron aumenta e mais estados tornam-se disponíveis para ocupação. Entretanto, porque não há estados disponíveis para elétrons ocuparem dentro da faixa de abertura, elétrons na fronteira da faixa de condução devem perder pelo menos de energia de maneira a realizarem a transição a outro estado disponível.

A densidade de estados pode ser calculada para elétrons, fótons, ou fónons em sistemas MQ. É usualmente notado com um dos símbolos g, , n, ou N. É uma função g(E) da energia interna E, na qual a expressão g(E) dE representa o número de estado com energias entre E e E+dE.

Para converter entre energia e vetor de onda, a relação específica entre E e k deve ser conhecida. Por exemplo, a fórmula para elétrons é

- X

- FUNÇÃO GERAL E FUNDAMENTAL DO SDCTIE GRACELI.

E para fótons, a fórmula é

- X

- FUNÇÃO GERAL E FUNDAMENTAL DO SDCTIE GRACELI.

Pode também ser escrito como uma função da frequência angular , a qual é proporcional à energia. A densidade de estados é usada extensivamente em física da matéria condensada, onde pode referir-se ao nível de energia dos elétrons, fótons ou fônons em um sólido cristalino. Em sólidos cristalinos, há frequentemente níveis de energia onde a densidade dos estados dos elétrons é zero, o que significa que os elétrons não podem ser excitados a estas energias. A densidade dos estados também ocorre na regra dourada de Fermi, a qual descreve quão rápido as transições mecânico quânticas ocorrem na presença de uma perturbação.

Num sistema tridimensional, a densidade de estados em espaço recíproco (espaço k) é

- X

- FUNÇÃO GERAL E FUNDAMENTAL DO SDCTIE GRACELI.

onde V é o volume e n o número de pontos de ramificação que existem para um único valor de k. Estes pontos de ramificação são por exemplo o spin-acima e spin-abaixo estados para elétrons, as polarizações de fótons, e os modos longitudinais ou transversais para fônons.

Materiais cristalinos

Dado que em materiais (cristalinos), o número de escalas varia linearmente com o volume, uma diferente definição de densidade de estados é algumas vezes usada, na qual g(E) ou g(k) é o número de estados por unidade de energia (vetor onda) e por unidade de volume ou por unidade de célula da grade.

Em um material cristalino, onde os estados mecânico quânticos podem ser descritos em termos de seus vetores de onda k, a densidade dos estados como uma função de k é não dependente das propriedades do material. Das condições periódicas segue que em um volume arbitrário , somente vetores k são mantidos satisfazendo

- X

- FUNÇÃO GERAL E FUNDAMENTAL DO SDCTIE GRACELI.

onde são inteiros positivos ou negativos arbitrários. Usando

- X

- FUNÇÃO GERAL E FUNDAMENTAL DO SDCTIE GRACELI.

pode ser derivado que para uma matriz tridimensional o número de estados G(k) dk entre k e k+dk é

- X

- FUNÇÃO GERAL E FUNDAMENTAL DO SDCTIE GRACELI.

para um único caso.

Em sólidos, a relação entre E e k é geralmente muito complexa e dependente do material. Se a relação é conhecida, a expressão para a densidade dos estados é

- X

- FUNÇÃO GERAL E FUNDAMENTAL DO SDCTIE GRACELI.

A relação acima é somente significativa se a energia somente depende da manitude do vetor k.

A física estatística é o ramo da física que usa métodos da teoria das probabilidades e estatística e, particularmente, as ferramentas matemáticas para lidar com grandes populações e aproximações, na solução de problemas físicos. Pode descrever uma grande variedade de campos com uma natureza inerentemente estocástica. Suas aplicações incluem muitos problemas nos campos da física, biologia, química, neurologia e até mesmo em algumas ciências sociais, como a sociologia. Seu principal objetivo é esclarecer as propriedades da matéria sob conjuntos, em termos de leis físicas que regem o movimento atômico.[1]

Em particular, a mecânica estatística desenvolve os resultados fenomenológicos da termodinâmica a partir de uma análise probabilística dos sistemas de base microscópica. Historicamente, um dos primeiros tópicos da física onde foram aplicados métodos estatísticos foi o campo da mecânica, que se preocupa com o movimento de partículas ou objetos quando submetidos a uma força.

Mecânica estatística

A mecânica estatística fornece um quadro que relaciona as propriedades microscópicas de átomos e moléculas com as propriedades macroscópicas ou extensivas de materiais que podem ser observados na vida cotidiana. Portanto, ela explica a termodinâmica como um resultado natural da estatística, mecânica clássica e mecânica quântica ao nível microscópico. Por causa desta história, a física estatística é muitas vezes considerada como sinônimo de mecânica estatística ou termodinâmica estatística.

Uma das equações mais importantes da mecânica estatística (análogo à F = ma em mecânica, ou a equação de Schrödinger na mecânica quântica) é a definição da função de partição Z, que é essencialmente uma soma ponderada de todos os possíveis estados q disponíveis para um sistema .

X

FUNÇÃO GERAL E FUNDAMENTAL DO SDCTIE GRACELI.

onde é a constante de Boltzmann, T é a temperatura e E(q) é a energia do estado q. Além disso, a probabilidade de um determinado estado q ocorrer é dada por

X

FUNÇÃO GERAL E FUNDAMENTAL DO SDCTIE GRACELI.

Aqui, vemos que os estados de energia muito alta têm pouca probabilidade de ocorrência, um resultado que é consistente com a intuição.

A abordagem estatística pode funcionar bem em sistemas clássicos quando o número de graus de liberdade (e assim o número de variáveis) é tão grande que a solução exata não é possível, ou não é realmente útil. A mecânica estatística também pode descrever o trabalho na dinâmica não-linear, teoria do caos, física térmica, dinâmica dos fluidos (particularmente nos números de Knudsen elevados) e física de plasmas.

Embora alguns problemas em física estatística possam ser resolvidos analiticamente por meio de aproximações e expansões, as pesquisas mais atuais utilizam o poder de processamento de computadores modernos para simular ou aproximar soluções. Uma abordagem comum para problemas estatísticos é usar uma simulação de Monte Carlo para produzir uma ideia da dinâmica de um sistema complexo.

A teoria das probabilidades é o estudo matemático das probabilidades. Pierre Simon Laplace é considerado o fundador da teoria das probabilidades.[1]

Os teoremas de base das probabilidades podem ser demonstrados a partir dos axiomas de probabilidade e da teoria de conjuntos.

Os teoremas seguintes supõem que o universo Ω é um conjunto finito, o que nem sempre é o caso, como por exemplo no caso do estudo de uma variável aleatória que segue uma distribuição normal.

- A soma das probabilidades de todos os eventos elementares é igual a 1.

- Para todos os eventos arbitrários A1 e A2, a probabilidade de os eventos se realizarem simultaneamente é dada pela soma das probabilidades de todos os eventos elementares incluídos tanto em A1 como em A2. Se a intersecção é vazia, então a probabilidade é igual a zero.

- Para todos os eventos arbitrários A1 e A2, a probabilidade de que um ou outro evento se realize é dada pela soma das probabilidades de todos os eventos elementares incluídos em A1 ou A2.

As fórmulas seguintes exprimem matematicamente as propriedades acima:

- X

- FUNÇÃO GERAL E FUNDAMENTAL DO SDCTIE GRACELI.

- X

- FUNÇÃO GERAL E FUNDAMENTAL DO SDCTIE GRACELI.

- X

- FUNÇÃO GERAL E FUNDAMENTAL DO SDCTIE GRACELI.

- FUNÇÃO GERAL E FUNDAMENTAL DO SDCTIE GRACELI. PARA TODA FORMA DE FUNÇÃO E EQUAÇÃO EM :

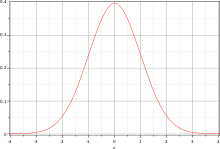

Em probabilidade e estatística, a distribuição normal é uma das distribuições de probabilidade mais utilizadas para modelar fenômenos naturais. Isso se deve ao fato de que um grande número de fenômenos naturais apresenta sua distribuição de probabilidade tão proximamente normal, que a ela pode ser com sucesso referida, e, portanto, com adequado acerto por ela representada como se normal fosse[1]. A distribuição normal é ligada a vários conceitos matemáticos como movimento browniano,[2] ruído branco,[3] entre outros. A distribuição normal também é chamada distribuição gaussiana, distribuição de Gauss ou distribuição de Laplace–Gauss, em referência aos matemáticos, físicos e astrônomos francês Pierre–Simon Laplace (1749 – 1827) e alemão Carl Friedrich Gauss (1777 – 1855).[4]

Em termos mais formais, a distribuição normal é uma distribuição de probabilidade absolutamente contínua parametrizada pela sua esperança matemática (número real ) e desvio padrão (número real positivo ). A densidade de probabilidade da distribuição normal é denotada como

- .

- X

- FUNÇÃO GERAL E FUNDAMENTAL DO SDCTIE GRACELI.

A distribuição normal com média nula e desvio padrão unitário é chamada de distribuição normal centrada e reduzida ou de distribuição normal padrão. Quando uma variável aleatória segue uma distribuição normal, ela é chamada de gaussiana ou de normal. Comumente é usada a notação com a variância quando A curva de densidade é chamada de curva de Gauss ou de curva em forma de sino.[5]

O papel central da distribuição normal decorre do fato de ser o limite de um grande número de distribuições de probabilidade como mostra o teorema central do limite, o qual permite estudar probabilisticamente a média das variáveis independentes de uma amostra aleatória simples de tamanho grande .[6] A distribuição normal corresponde ao comportamento do efeito agregado de experiências aleatórias independentes e semelhantes em certas circunstâncias quando o número de experiências é muito alto.[7] Com esta propriedade, a distribuição normal pode aproximar–se da distribuição de efeito agregado de outras distribuições e modelar vários estudos científicos como erros de medição ou testes estatísticos com as tabelas de distribuição normal.[8]

Histórico

Uma das primeiras aparições da distribuição normal ocorreu em 1733 com Abraham de Moivre com o aprofundamento do estudo de fatorial quando considerado um jogo de cara ou coroa.[9] Em 1756, ele publicou A Doutrina das Chances, em que a distribuição normal aparece como o limite de uma distribuição binomial, o que originaria o teorema central do limite.[10]

Em 1777, Pierre-Simon Laplace retomou o trabalho e obteve uma boa aproximação do erro entre a distribuição normal e a distribuição binomial em razão da função gama de Euler.[9] Em seu livro publicado em 1781, Laplace publica uma primeira tabela da distribuição normal. Em 1809, Carl Friedrich Gauss assimila os erros da observação na astronomia à curva, erros da densidade da distribuição normal.[10]

A distribuição normal é totalmente definida quando o primeiro teorema central do limite (chamado então teorema de Laplace) é elaborado por Laplace em 1821.[10] O nome normal é dado por Henri Poincaré no fim do século XIX.[11] A distribuição normal também pode ser chamada de distribuição de Gauss ou distribuição de Laplace–Gauss,[12] de acordo com sua autoria. A denominação segunda distribuição de Laplace também é usada ocasionalmente.[13][14]

A distribuição normal é estudada frequentemente. Por exemplo, novas tabelas digitais foram publicadas por Egon Sharpe Pearson em 1948, pelo National Bureau of Standards em 1952 e por Greenwood e Hartley em 1958.[15][16]

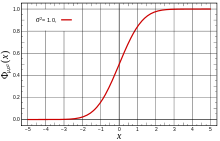

Distribuição normal padrão

Existe uma infinidade de distribuições normais, cada uma com sua própria média e desvio padrão. A distribuição normal com média 0 e desvio padrão 1 é chamada de distribuição normal padrão.[17] Ela é uma distribuição de probabilidade (uma medida , de massa total unitária) unidimensional (com suporte real ).[18] É uma distribuição absolutamente contínua (a medida é absolutamente contínua em relação à medida de Lebesgue).

Em outras palavras, existe uma densidade de probabilidade muitas vezes denotada como para a distribuição normal padrão tal que: . É generalizada para a distribuição normal multivariada. A distribuição normal padrão também pode ser chamada de distribuição normal centrada e reduzida.[19] A escala horizontal do gráfico da distribuição normal padrão corresponde ao escore-z que é uma medida de posição que indica o número de desvios padrão em que um valor se encontra a partir da média. Podemos transformar um valor em escore-z usando a fórmula:

Arredondar para o centésimo mais próximo

Quando um valor de uma variável aleatória distribuída normalmente é transformado em um escore-z, a distribuição de será uma distribuição normal padrão. Após essa transformação, a área que recai no intervalo sob a curva normal padrão é a mesma que aquela sob a curva normal padrão no correspondente intervalo .[21]

Propriedades da distribuição normal padrão

- A área acumulada é próxima de 0 para escores-z próximos a z=-3,49.

- A área acumulada aumenta conforme os escores-z aumentam.

- A área acumulada para z=0 é 0,5000.

- A área acumulada é próxima a 1 para escores-z próximos a z=3,49.

Definição pela função densidade

A densidade da distribuição normal padrão é dada pela função definida por , para todo .[22] Esta distribuição é chamada centrada porque o valor do seu momento de ordem 1 (esperança) é 0 e reduzida porque o valor do seu momento de ordem 2 (variância) é 1, assim como o seu desvio padrão. O gráfico da densidade é chamado função gaussiana, curva de Gauss ou curva em forma de

sino. A distribuição normal é denotada pela letra . Uma variável aleatória que segue uma distribuição normal padrão é denotada como .[23]

Seguem algumas propriedades sobre a função densidade:

- O cálculo da integral de Gauss permite demonstrar que a função é uma densidade de probabilidade pela fórmula .

- É contínua, uniformemente limitada e par.[24]

- O máximo da função é atingido na média 0 e de valor .[24]

- Verifica .[25]

- A densidade é infinitamente derivável. Uma indução matemática permite obter a fórmula para a -ésima derivada de : , em que é o –ésimo polinômio de Hermite.[26]

- A densidade possui dois pontos de inflexão, em 1 e em –1. Estes são os pontos em que a segunda derivada se anula e muda de sinal. Os dois pontos são aproximadamente três quintos da altura total.[18]

Definição pela função distribuição

Historicamente a distribuição normal aparece como a distribuição limite no teorema central do limite, usando a função de distribuição cumulativa. A distribuição normal é a distribuição de probabilidade, em que a função de distribuição é dada por , definida por

, para todo . Ela fornece a probabilidade de uma variável aleatória de distribuição normal pertencer a

um intervalo fechado , .[27]

Seguem algumas propriedades sobre a função de distribuição:

- Não existe uma expressão analítica para a função de distribuição . Isto é, não é expressa a partir de funções usuais, mas torna–se uma função usual. Para obter os valores de probabilidade é preciso aproximar esta função de outras funções usuais gerando a tabela de valores.[28]

- Pode ser expressa em função da função erro por meio das seguintes fórmulas equivalentes e .[29]

- É infinitamente derivável e verifica . A fórmula equivalente permite definir a integral de Lebesgue–Stieltjes com relação à distribuição normal.[30]

- É absolutamente contínua e estritamente crescente, sendo uma bijeção de no intervalo aberto .[31] O recíproco é chamado de função inversa da função distribuição acumulada da distribuição normal. Por exemplo, esta função é utilizada pelo modelo probit.[32]

- Pela paridade da distribuição, . Portanto, . Isso mostra que a mediana da distribuição normal padrão é 0.[31]

Definição pela função característica

A caracterização da distribuição normal pela função característica tem o objetivo de demonstrar certas propriedades como a estabilidade da soma e o teorema central do limite. A função característica de distribuição normal padrão é dada por

e definida por , para todo .[33][34] Em grego existem duas variações para a letra phi minúscula. O utilizado agora é diferente do utilizado no início do texto. Isto é, são duas notações diferentes para phi minúsculo.

Esta função característica é proporcional à densidade da distribuição padrão. Ela permite demonstrar certas propriedades como a estabilidade por adição e o teorema central do limite.[35]

Seguem algumas propriedades sobre a função de distribuição:

- A função característica da distribuição normal pode ser obtida a partir da função densidade pelas igualdades .[27]

- Se uma variável aleatória segue uma distribuição normal padrão da função característica definida acima, então a transformação linear admite a função característica . É uma variável aleatória com distribuição normal de média e variância .[36]

Definição pela função geradora de momentos

Uma outra maneira de definir a distribuição normal padrão é pela utilização da função geradora de momentos. É a distribuição de probabilidade, em que a função geradora de momentos é dada por e definida por[37] , para todo . O objetivo é calcular os momentos da distribuição normal.[38]

Seguem algumas propriedades sobre a função geradora de momentos:

- A função geradora de momentos da distribuição normal pode ser obtida a partir da função densidade. Seja , que segue uma distribuição normal padrão, então .[37]

- Se uma variável aleatória segue uma distribuição normal padrão da função geradora de momentos , então a transformação linear admite a função geradora de momentos . Assim, é uma variável aleatória com distribuição normal de média e variância .[38]

Distribuição normal geral

Definição

Mais usualmente que a distribuição normal padrão, a distribuição normal não centrada e não reduzida é a distribuição de probabilidade absolutamente contínua, na qual um dos quatros pontos seguintes podem ser verificados.

de energia de maneira a realizarem a transição a outro estado disponível.

de energia de maneira a realizarem a transição a outro estado disponível.

![{\displaystyle P\left[A_{1}\cap A_{2}\right]=\sum _{\omega \in A_{1}\cap A_{2}}P\left(\left\{\omega \right\}\right)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bb07dcc4626999fafe2ff44165a33028490c89cf)

![{\displaystyle P\left[A_{1}\cup A_{2}\right]=\sum _{\omega \in A_{1}\cup A_{2}}P\left(\left\{\omega \right\}\right)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/22a87bde65fafc3c0f682cdea3e1a1094255cfe7)

![{\displaystyle [a,b]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935)

![{\displaystyle \mathbb {P} (X\in [a,b])=\Phi (b)-\Phi (a)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/34021ca68e186eb6321321cf619fd9271e0c3129)

![{\displaystyle ]0,1[}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6f6a83a50a400fb17f0c9abe6e674c6526a7b0e1)

![{\displaystyle M(t)=\mathbb {E} [e^{tX}]={\frac {1}{\sqrt {2\pi }}}\int _{-\infty }^{+\infty }{\rm {e}}^{xt}{\rm {e}}^{-{\frac {x^{2}}{2}}}\mathrm {d} x={\frac {1}{\sqrt {2\pi }}}\int _{-\infty }^{+\infty }{\rm {e}}^{-({\frac {(x-t)^{2}-t^{2}}{2}})}\mathrm {d} x={\rm {e}}^{\frac {t^{2}}{2}}\,{\frac {1}{\sqrt {2\pi }}}\int _{-\infty }^{+\infty }{\rm {e}}^{-{\frac {x^{2}}{2}}}\mathrm {d} x={\rm {e}}^{\frac {t^{2}}{2}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/3be141704e1e748c82a326f00e19ab163acac2fb)

Comentários

Postar um comentário